【AIエージェント】社会シミュレーションが可能になった未来、人間が果たす役割とは?

「アイザック・アシモフの『ファウンデーションシリーズ』では心理歴史学者が銀河帝国の未来を統計的に予測するんですが、そういう集団行動の予測が実際にできるんじゃないかと思ったんですよ」。小川修平氏のインタビューはSFの名作の話から始まった。社会心理学や計算機科学の研究者らとともに「社会シミュレーション」の研究を主導する小川氏のお話から、未来の組織と人間の働き方を想像してみよう。

Technology, Culture

-

小川 修平/おがわ しゅうへい

株式会社エモスタ CEO

インディアナ大学経済学部・政治学部卒業。投資銀行やM&Aブティックでの業務を経験し、2017年に臨床心理学者でAIエンジニアでもある義弟とともに株式会社エモスタを創業。感情認識AI「エモリーダー」を中心としたプロダクト開発や研究支援サービスなどを提供。2023年から社会シミュレータ事業を開始し、領域横断的な研究チームを組成して研究開発を推進。

集団の動きを仮想的に再現する「社会シミュレーション」

組織づくりや働く空間の設計には、実際にやってみないとうまくいくかわからない難しさがつきものだ。アイデア創発を狙って組織構造の再編を試みたり、コミュニケーションスペースを設けたりしても、ふたを開けてみれば期待していたアクションが起こらないのは、よくあることではないだろうか。

人間同士の相互作用や社会の動きは、個々の性格や持っている知識の違い、誰と誰がどのような順番で関わり合うかといった、極めて多くの要因が複雑に絡み合う。さらには、化学の実験のように同じ条件で再現することも不可能なことから、実態理解や結果の予測が困難な現象だ。極端に言ってしまえば「出たとこ勝負」になりかねない人間同士の相互作用。どんな働きかけをしたらどういう結果になるのか、事前に試してみたくはないだろうか。

小川氏が手掛ける「社会シミュレーション研究」は、人間同士の関わり合いの結果として生まれる社会の動きをコンピュータ上で仮想的に表現するものだ。人間を模した個体(エージェント)を動かすことで、個体同士のやりとりがどのように行われ、結果的に集団全体がどのような状態に向かうのかを調べることができる。

ポイントは、各エージェントの行動の背景に大規模言語モデル(LLM)が組み込まれているところだ。LLMは、人間が使う言語を高い精度で読み取って生成できる技術で、ここ数年で一気に普及が進んだ生成AIの基盤にもなっている。これをエージェントのいわば頭脳として設定することで、人間同士が話しているような自然な会話が行われ、会話の結果を蓄積して次の行動指針をつくることが可能となる。従来のシミュレーションよりもさらに自律的な社会行動を表現できるようになるのだ。

小川氏のプロジェクトの源流にもなっている、Google社とスタンフォード大学のチームによる研究* では、エージェントが仮想空間上で仕事に出かけたり、互いに会話をしたりと、自律的に日常生活を営むことが報告され、人間社会を信憑性高くシミュレーションできる可能性が話題を呼んだ。小川氏らの研究チームでは、この研究を土台に独自の応用を加えて、研究と実践応用に向けたツール開発を進めている。

知がつながる場をどうつくるか。AIで考えるコミュニケーション設計

社会シミュレーションの応用先としては、コミュニケーション活性化を課題とする多くの領域が想定される。

コンパクトなところだと、たとえば研修プログラムの参加者同士の交流を促す仕掛けづくりが考えられるという。アイデア創出や組織活性化を狙った集合型の研修やワークショップを導入している企業も多いが、参加者同士の相互交流が企画の主要コンテンツの場合、コミュニケーションの活発さが研修効果やアウトプットに直結する。グループワークの組み合わせやテーマの投げかけ方など、変数が多く設計が悩ましい場面だ。

LLMを用いたAIエージェントには、行動傾向や保有知識を事前にインプットすることで、ふるまい方に個性を持たせられる特徴がある。これを応用すると、グループワークの受講者の役割や得意分野などをインプットすることで、あらかじめ交流をシミュレーションすることができるようになるという。

「研修当日にどのようなディスカッションになりそうか、前もって方向性をつかんだ上で場の進行を設計したり、相性のよさを考慮したマッチングを考えたりできるようになるのではないでしょうか」と小川氏は可能性を語る。

将来的には、部署や企業の規模への拡張や、より長期的な動向を追うようなシミュレーションも期待されるという。「化学メーカーのように研究開発を基軸とした大手企業だと千人規模の研究者がいますが、どのように専門知識同士のシナジーを生み出すかはマネジメントにおける重要な課題となっています」

研究者の場合、成果をまとめたレポートや論文が当人の専門知識や得意分野を表現するデータとなる。千人を超える組織では研究者同士の組み合わせは膨大なため、アイデア創出を実地でコーディネートするのは現実的に難しい。そこで、各自が執筆した論文をAIエージェントにインプットすることで、アイデア創出ができるようになるだろう。

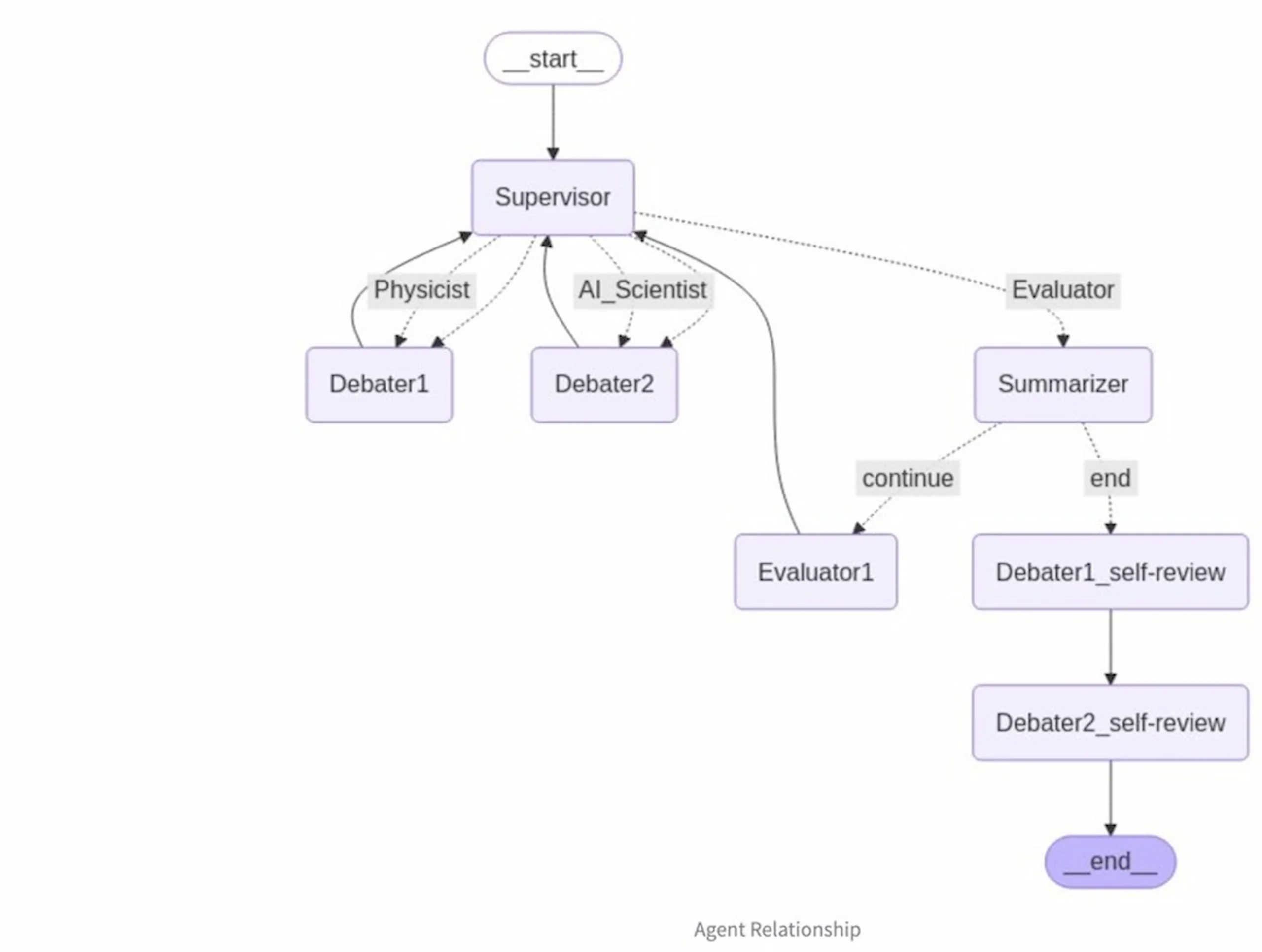

小川氏らは、実際にさまざまな分野の専門知識を備えたエージェントを登場させ、テーマについて仮想の議論を交わすミニアプリも開発している。多様な専門知識の組み合わせから先進的な研究アイデアを探索したり、得られた出力をもとに実際の専門家同士の議論の起点としたりする応用が見込まれる。

コンピュータをより「バカ」にする研究

小川氏らの研究チームではツール開発と並行して、社会心理学の研究者を主軸とした研究も進めている。

「AIエージェントたちのふるまいはあくまでもシミュレーションなので、実際の人間の行動や集団の動きをきちんと予測できているか、リアリティがあるのかが重要な問題となります。そのためには、実際の人間の思考や行動の仕組みがどうなっているかを押さえて設計する必要がありますね」

たとえば、Google社の研究では各エージェントの経験が1つずつリストの形で蓄積されているが、人間の記憶は関連する要素同士がネットワーク状に絡み合った構造になっていることが指摘されている。どちらの構造を組み込むかによって、記憶や連想の引き出され方が違ってくるだろう。

こうした人間理解を考えていくと、研究開発の方向性に独自の指針が生まれてくる。

「論理的な推論を正確に速くできるようにしたい、つまりもっと頭を良くしていきたいという方向の研究がLLMの分野では多いんですけど、僕らはもっと『バカ』にしたいんですよ。極端な表現ですけどね(笑)」

小川氏が言う「バカ」は、より自然な人間のふるまいに近いことを意味する。膨大なデータをもとに学習しているLLMと比べると、個々の人間は知識量が圧倒的に少ない。また、追い込まれた状況で焦って判断を間違えたり、夜中にはラーメンを食べないルールを設けているのについつい食べてしまうような衝動的な行動をとったりすることも、人間には自然に見られるだろう。

こうしたある種の不合理さは、論理性を追い求める方向で開発されるLLMでは欠陥として取り除かれるが、人間社会の再現を目指すのであれば、リアルな人間の特徴として内包されるべきではないだろうか。「世の中のLLMはどんどん賢くなっていくので、うまく賢さを制限するためのチャレンジが僕らには逆に発生しています」と小川氏は笑顔を見せる。

リアリティを持たせるという点では、個人の知識を再現するツールを開発するときに、何を情報として与えるかも試行錯誤の最中だという。研究者であれば論文などの出版物がありえるが、そうでない人であれば何を情報源とするのがよいだろうか。個人情報や人事情報の活用も慎重になされる必要がある。

人間理解にはリアリティが必要な一方で、ツールを開発する上では正確な再現を追求しない路線もあると小川氏は言う。「たとえばアイデアを探索するツールで研究者の論文を事前情報にするときに、その人の“人付き合いが苦手”といった弱点まで、わざわざ再現する必要はないわけです。どこまでオリジナルに似せるかは目的次第ですね」

AIエージェントと協働する未来で人間が担う仕事とは?

社会シミュレーションの研究開発が進んだ先に、リアルワールドの「人間」が担う役割は何だろうか?

「1つには、自分たちにとっての『よいアイデア』とか『よい研究』の評価軸を定めることですね」と小川氏。

新規性の高いアイデアや研究も、単に前例がないだけでは不十分だ。実行した結果、組織や社会にとって意味のあるものでなくてはならない。「よいアイデアとはどのようなものか」が定まっていないと、シミュレーション結果のよしあしを評価することができず、有効に活用できない。方針を与えたり結果を選別したりする基準を与えるのが、人間が担う仕事になるだろう。

加えて、社会シミュレーションから得られたアイデアが人間とうまく結びつかないと、組織ではなかなか実行されにくいと小川氏は指摘する。画期的なアイデアがあったとしても「私がやる」と主体性を持って推進する人がいなくては形にならない。AIエージェントが出したアイデアは、どうしても外から与えられた感を伴いやすく、主体性が生まれづらくなる。コストをかけて生み出したアイデアが、実践する人が曖昧なままお蔵入り……。既存のアイデア出しワークショップでもよく見られる残念な結末だ。

自分ごととして意志を持って推進することは、評価軸を定めることに加えて人間が果たし続ける役割の1つとなりそうだ。得られた着想に主体性を持たせる仕掛けは、社会シミュレーションを実効的なツールとして活用する上でポイントとなるだろう。そのためのシンプルな工夫として、小川氏は「名付け」を挙げる。

「各自の情報を読み込んだAIエージェントにその人の名前を付けるんです。僕もやってるんですが不思議なもので感情移入が起きて、そいつがしょうもないアイデアを出してくるとイラッともするんですよね。自分の背景知識を汲んだ『自分AI』が出したアイデアって、ちょっと試してみたくなりませんか?」

シミュレーションやAIエージェントと聞くと、コンピュータ上のドライな営みという印象を持たれがちだが、小川氏の主導する研究開発の根底にはリアルな人間理解があり、私たちの仕事や生活と地続きであると感じられる。AIエージェントと人間がアイデアを共創する未来の働き方は、これまで以上に人間らしさが問われるものになっていくのではないだろうか。

-

- 文献

- * Park, J. S., O’Brien, J., Cai, C. J., Morris, M. R., Liang, P., & Bernstein, M. S. (2023). Generative agents: Interactive simulacra of human behavior. In Proceedings of the 36th annual acm symposium on user interface software and technology (pp. 1-22).

- 連載「Scientific Implications」のその他の記事はこちら

本記事はリサーチコミュニティ会員限定記事です。

リサーチコミュニティとは、総務などオフィス運用やマネジメントに携わる人のみの会員制サービスです。

限定記事の閲覧のほか、各種特典もご用意しております。